视觉与毫米波雷达数据融合算法在智能交通中的应用研究

机械工程资助企业:

上海觉云科技有限公司

上海觉云科技有限公司

企业导师: 常伟

指导教师: 李彦明

项目成员: 郑泽州,吴培铭

项目简介

项目简介

项目概述

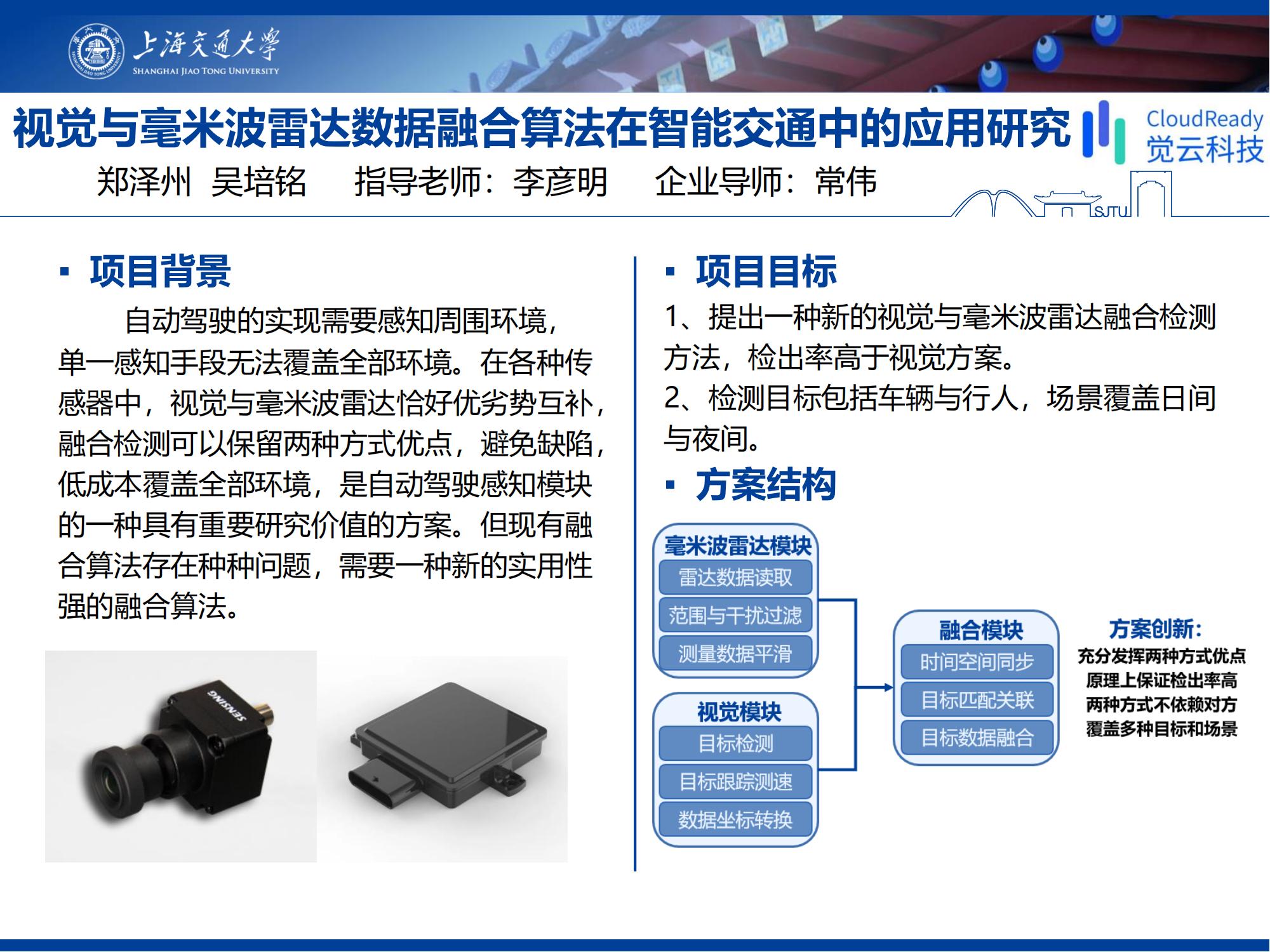

自动驾驶的实现需要感知周围环境,单一感知手段无法覆盖全部环境。在各种传感器中,视觉与毫米波雷达恰好优劣势互补,融合检测可以保留两种方式优点,避免缺陷,低成本覆盖全部环境的感知,是自动驾驶感知模块的一种具有重要研究价值的方案。但现有融合算法存在种种问题,需要更加实用的融合算法。本项目在充分研究现有方法的基础上提出一种新的融合检测算法,使用一些创新性的方法手段避免现有算法问题,取得良好的效果,相比单一检测手段在检出率和测量精度上都有提升,并且适用检测目标和场景多,满足了企业要求。

项目目标

目前开源的毫米波雷达与图像融合算法,一般性能较低或配置复杂,依赖于视觉,对毫米波雷达信息使用不足,尤其对夜间情况没有深入研究,没有验证同时完成汽车和行人检测的能力,难以具备实际应用价值,因此需要满足实际应用、可快速部署、能够形成产品原型的融合算法。检测算法部署在车载计算平台上,检测目标类别包括车辆和行人,适用场景覆盖日间和夜间,检出率高于纯视觉检测,识别速度每帧小于0.1秒。

项目成果

从毫米波雷达获取原始数据,通过使用阈值过滤与生命周期法管理,以及卡尔曼滤波器,提高毫米波雷达数据的可信度和测量精度。

视觉使用YOLOv5算法进行目标检测,对检测目标通过多目标跟踪和坐标系转换实现单靠视觉获取车辆坐标系下位置速度信息。

提出了一种新的融合检测算法,使用一些创新性的方法手段避免现有算法问题,取得良好的效果,相比单一检测手段在检出率和测量精度上都有提升,尤其是夜间检出率提高约20%,并且适用检测目标和场景满足了企业要求。